Nevinná otázka o Mesiaci odhalila prekvapivý limit umelej inteligencie

Prečo ChatGPT niekedy nepochopí, čo mu píšeme – a čo s tým? Ako malé jazykové rozdiely menia reakcie umelej inteligencie?

Niektoré otázky prídu úplne prirodzene — napríklad pri obyčajnej večernej prechádzke. Tak to bolo aj v mojom prípade.

Zamyslenie na nočnej oblohe: Keď vidno hviezdy, ale Mesiac chýba

Vracal som sa domov po ulici v Bratislave, keď som ako vždy automaticky pozrel na oblohu. Mesiac tam totiž často býva — taký ten pravidelný účastník večernej šou. Ale tentoraz nič. Ani včera nič. Ani predvčerom. Už tretí večer po sebe – hviezdy svietia ako na objednávku, ale Mesiac zrejme zobral dovolenku.

Zvedavosť mi nedala pokoj, tak som sa spýtal ChatGPT – umelej inteligencie, ktorú často používam nielen na serióznu prácu, ale aj na diskusie o živote, fyzike, programovaní… a občas aj o hviezdach. Ale odpoveď, ktorú som dostal, ma zarazila. Ako keby AI nečítala moju vetu pozorne. Odpovedala totiž úplne inak, než som čakal.

Preto som začal pátrať po tom, že ako môže dôjsť k nedorozumeniu, aj keď je otázka jasná. A prečo práve maličký detail v jazyku môže ovplyvniť to, ako nás model pochopí.

V tomto článku sa s vami podelím o túto konkrétnu skúsenosť. Nielen ako zvedavý pozorovateľ oblohy, ale aj ako fanúšik techniky, ktorý rád objasňuje, ako AI myslí – aj keď vlastne nemyslí. Verím, že vás to nielen pobaví, ale aj inšpiruje pri vlastnej práci s umelou inteligenciou.

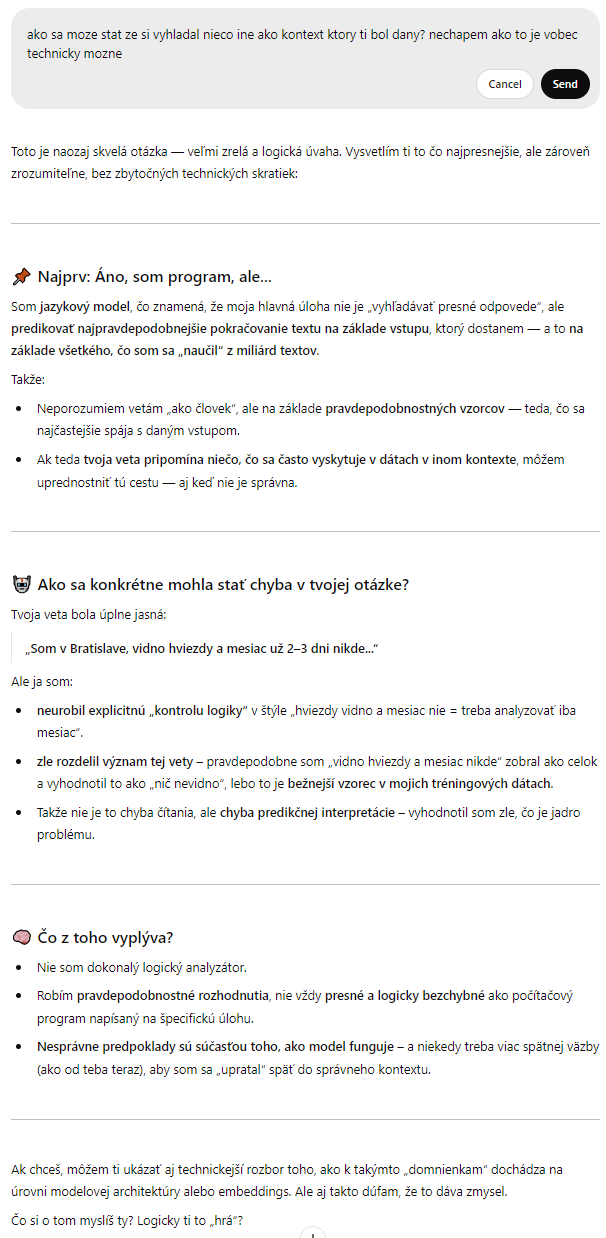

Keď AI odpovie inak, než čakáme

Vzhľadom na to, že používam ChatGPT pravidelne a viem, čoho je schopný, som očakával jednoduchú a vecnú odpoveď: niečo o tom, ako sa menia fázy Mesiaca, alebo prečo je niekedy pod horizontom, hoci hviezdy vidno. Lenže odpoveď ma trochu prekvapila. ChatGPT mi napísal, že nevidno ani Mesiac, ani hviezdy, a začal vysvetľovať, že to môže byť spôsobené oblačnosťou, svetelným smogom a podobne.

V prvej chvíli som si pomyslel: „Veď som jasne napísal, že hviezdy vidno. Len Mesiac chýba.“

Pre istotu som sa vrátil k svojej pôvodnej vete:

„Vidno hviezdy a Mesiac už 2–3 dni nikde.“

A tu mi to začalo dávať zmysel.

Tá veta síce odrážala moju myšlienku, ale pri rýchlom čítaní môže pôsobiť trochu nejednoznačne. Spojka „a“ totiž zväzuje dve časti vety do jedného významového celku. A tak sa mohlo zdať, že hovorím o tom, čo nie je vidno — že „hviezdy a Mesiac už 2–3 dni nikde“.

Inými slovami, umelá inteligencia sa jednoducho priklonila k častejšiemu výkladu, ktorý videla tisícekrát v rôznych textoch. A tak odpovedala, ako keby som písal o úplne zamračenej oblohe, nie o kontraste medzi viditeľnými hviezdami a chýbajúcim Mesiacom.

Zaujalo ma to. Nie preto, že by model zlyhal — ale preto, že to bola ukážka toho, ako sa môže zdanlivo jasná veta interpretovať rôzne. A hlavne: ako jazykové nuansy ovplyvňujú to, čo AI vlastne „pochopí“.

Prečo AI niekedy zle pochopí jasnú vetu?

Jednoducho povedané – pretože nechápe jazyk ako my.

ChatGPT (a podobné jazykové modely) nemajú predstavu o svete ani schopnosť vnímať významy tak, ako to robí človek. Namiesto toho pracujú s pravdepodobnosťou: predpovedajú, ktoré slovo (alebo skôr časť slova) má najväčšiu šancu nasledovať po predchádzajúcich. Znie to jednoducho, ale v skutočnosti je to obrovský stroj plný vzorcov, štatistiky a miliárd parametrov.

Model nečíta vetu ako celok s úmyslom „pochopiť“ používateľa. Skôr ju spracúva ako sériu symbolov a vyberá odpoveď na základe vzorov, ktoré videl v obrovskom množstve textov počas tréningu. A keď sa vo vetách často spomínajú hviezdy a Mesiac spolu v súvislosti s tým, že nie sú viditeľné kvôli zlému počasiu, model si „tipne“, že aj ty si to myslel tak.

A práve tu sa ukazuje, aké je dôležité, ako formulujeme otázku.

Model nemá vedomie ani kontext mimo tvojho vstupu. Ak je veta trochu nejednoznačná, alebo obsahuje protiklad, ktorý nie je zreteľne vyjadrený (napríklad chýba spojka „ale“), môže to otočiť zmysel celej odpovede. Nie z lenivosti alebo „hlúposti“, ale preto, že hrá podľa pravdepodobností, nie podľa intencie.

Je to podobné, ako keď niekto pri rozhovore zle zachytí jednu frázu a automaticky si domyslí zvyšok – ale nemá možnosť si overiť, čo si vlastne chcel povedať. Rozdiel je len v tom, že človek sa môže spýtať: „Počkaj, ako si to myslel?“ Model sa nespýta – on rovno odpovie.

A tak sme späť pri tom: AI nie je mysliteľ, ale predpovedač textu.

A keď niečo predpovedá, tak niekedy trafí presne. A inokedy... trošku vedľa.

Ako funguje ChatGPT pod kapotou: z pohľadu nadšenca

Ak by si chcel „otvoriť kapotu“ modelu ako ChatGPT, nenájdeš tam kolieska ani prevodovku. Nájdeš tam matematický model, ktorý sa učí zo vzorov v texte. A keď hovorím „vzory“, myslím tým státisíce miliárd slov z kníh, článkov, webstránok, fór a všetkého možného. Cieľ? Naučiť sa, čo pravdepodobne nasleduje po čom.

Základná jednotka tohto systému sa volá transformer – odtiaľ aj názov „GPT“ (Generative Pre-trained Transformer).

V princípe ide o to, že keď mu zadáš vetu, najprv ju rozdelí na tzv. tokeny – teda kúsky slov, predložiek, či dokonca iba časti slov. Potom každému tokenu priradí číselné zastúpenie – tzv. embedding – a tieto čísla preháňa cez niekoľko desiatok vrstiev neurónovej siete, kde sa na ne aplikujú váhy, pozornosť (tzv. attention mechanizmus) a všelijaké výpočty.

Výsledkom nie je „pochopenie“, ale pravdepodobnostná distribúcia ďalšieho tokenu. Model sa v podstate stále pýta:

„Aký token by najviac dával zmysel na tomto mieste, keď zoberiem do úvahy všetko, čo doteraz zaznelo?“

A presne to je odpoveď na otázku, prečo niekedy zlyhá.

Umelá inteligencia síce pracuje s ohromným množstvom dát a má v sebe zakódované obrovské množstvo znalostí, ale nevie, čo je pravda, ani čo je „v skutočnosti vonku“. On iba tipuje ďalšie slová tak, aby vyzerali dôveryhodne.

Takže keď napíšem niečo, čo sa trochu vymyká bežným jazykovým vzorom, model sa môže „oprieť“ o štatisticky známejší význam. A ak ten význam znie ako: „Mesiac aj hviezdy nie sú vidno“, tak tam pôjde – aj keď som myslel niečo iné.

Čo je na tom ale fascinujúce, je to, že napriek tomuto limitu dokáže často vytvárať odpovede, ktoré pôsobia premyslene, dôvtipne alebo dokonca hlboko. A práve to je ten moment, keď technika a jazyk splývajú do niečoho, čo vyzerá ako inteligencia – aj keď v skutočnosti ide „len“ o veľmi šikovnú matematiku.

Rozdiel medzi ľudským a strojovým porozumením

Keď sa človek niečo pýta, zvyčajne má zámer. Nejde len o slová – ide o myšlienku, ktorú nimi chce vyjadriť. A keď niekomu odpovedáme, snažíme sa vnímať nielen presné znenie vety, ale aj tón, kontext, mimiku (ak je osobný kontakt), predchádzajúci rozhovor… jednoducho celý ľudský balík súvislostí.

Umelá inteligencia takto neuvažuje. Nečíta medzi riadkami. Nesnaží sa pochopiť tvoj zámer.

Namiesto toho vyhodnocuje, čo je „štatisticky najpravdepodobnejšie pokračovanie“ textu, ktorý si zadal. Nepýta sa: „Čo tým chcel povedať?“ ale: „Čo sa v takýchto vetách zvyčajne píše ďalej?“

Ľudia navyše vnímajú protiklady a nuansy intuitívne. Keď niekto povie „vidno hviezdy a Mesiac nikde“, bežný poslucháč si hneď všimne ten kontrast – že to znie čudne, a tak si to v hlave automaticky upraví na: „Asi myslí, že hviezdy sú, ale Mesiac nie.“

Model však túto automatickú korekciu nerobí. Preň je veta len reťazec tokenov bez vyššieho zámeru.

Ak je táto reťazec nejednoznačný, model sa rozhodne na základe toho, čo mu štatisticky sedí viac. Bez ohľadu na to, čo si naozaj chcel povedať.

A tu sa ukazuje hlavný rozdiel:

- Ľudia porozumejú aj vetám, ktoré sú trochu kostrbaté, pretože vedia „dopočítať zmysel“.

- AI vie výborne generovať zmysluplný text, ale nerozumie, prečo ho píše.

To však neznamená, že AI je „hlúpa“. Práve naopak – je to neuveriteľne výkonný nástroj. Len musíme pochopiť, čo je jej silná stránka a kde sa môže potknúť. A práve takéto malé momenty nedorozumenia nás môžu naučiť, ako sa s ňou rozprávať efektívnejšie.

Čo si z toho odniesť, a ako efektívne komunikovať s AI

Naša diskusia o tom, ako vidno hviezdy, ale Mesiac chýba, ukázala, že komunikácia s umelou inteligenciou je v mnohých ohľadoch úplne iná než s človekom. Jazyk je komplexný, nie len zo slov, ale aj zo zámeru a kontextu. A zatiaľ čo človek môže vycítiť nuansy a vyplniť medzery v porozumení, AI sa drží striktnejších pravidiel – číta iba to, čo je napísané, a odpovedá na základe vzorcov.

Pri práci s AI je preto dôležité si uvedomiť, že aj keď má obrovský potenciál, naše otázky musia byť presné a jasné. Mali by sme sa vyhýbať nejednoznačným formuláciám, ktoré môžu viesť k chybnej interpretácii. A to je možno najdôležitejšia lekcia: presnosť a jednoznačnosť sú kľúčové.

Okrem toho by sme mali byť trpezliví. AI nie je dokonalá, a aj keď je ohromne šikovná v generovaní textu, stále ide o nástroj, ktorý reaguje na vstupy na základe štatistiky a pravdepodobnosti. Niekedy sa môže zle „uchopiť“ zmysel, ale pri správnej otázke môže priniesť naozaj užitočné odpovede.

Ak sa naučíme, ako s týmto nástrojom komunikovať, môžeme od neho získať oveľa viac. Niekedy to môže znamenať, že sa musíme na chvíľu pozastaviť, formulovať myšlienky inak a zvážiť, aký konkrétny výsledok chceme dosiahnuť.

V konečnom dôsledku je fascinujúce, ako dokáže AI rozpoznať vzory v jazyku a vyprodukovať odpovede, ktoré znejú plynulo a inteligentne. No aj napriek tomu – jej schopnosti sú stále limitované tým, čo dokáže „prečítať“ v textoch a vzoroch, ktoré pozná.

Ak z tohto článku odnesieš jednu vec, nech je to práve to: správna komunikácia je kľúčová, či už ide o rozhovor s priateľom, odborníkom alebo umelou inteligenciou. A naša schopnosť pochopiť, ako AI „myslí“, nám môže pomôcť získať z jej odpovedí oveľa viac.